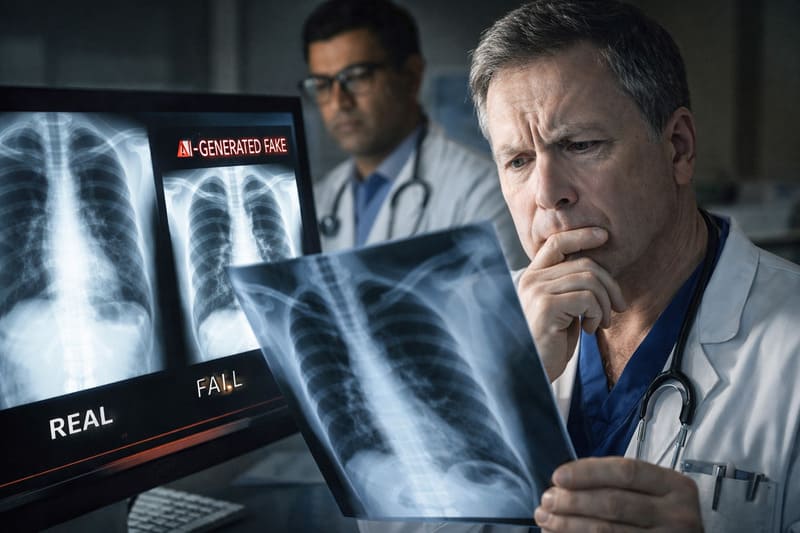

Studija objavljena 24. marta 2026. u časopisu Radiology pokazala je da ni radiolozi ni multimodalni modeli veštačke inteligencije ne uspevaju lako da razlikuju autentične rendgenske snimke od slika generisanih putem AI sistema. Ovakvi nalazi otvaraju ozbiljna pitanja o pouzdanosti današnje dijagnostike, bezbednosti digitalnih medicinskih zapisa i zaštiti integriteta istraživanja u radiologiji.

Lažni rendgeni koje je napravio ChatGPT

Zamislite situaciju u kojoj polovina medicinskih snimaka u istraživačkom skupu podataka nije nastala u rendgen kabinetu, već u nekom od sistema “veštačke inteligencije”. Upravo to je jedan od mogućih scenarija koji opisuje nova studija koja je privukla pažnju i radiologa i eksperata za bezbednost AI sistema širom sveta.

U retrospektivnoj studiji učestvovalo je 17 radiologa iz 12 centara u šest zemalja, sa rasponom profesionalnog iskustva od 0 do 40 godina. Analizirano je ukupno 264 radiograma, pri čemu je polovina bila autentična, a polovina generisana uz pomoć veštačke inteligencije. Ispitivanje je obuhvatilo dva odvojena skupa podataka: prvi sa realnim i ChatGPT-generisanim snimcima više anatomskih regija, a drugi sa rendgenogramima grudnog koša, u kojem su sintetičke slike dobijene pomoću otvorenog difuzionog modela RoentGen, razvijenog na Medicinskom fakultetu u Stanfordu.

Rezultati: Pogrešna procena u jednom od četiri slučaja

Rezultati su pokazali da je problem mnogo ozbiljniji nego što se možda pretpostavljalo. Učesnicima u prvoj fazi nije bilo saopšteno koja je svrha studije, već su ih samo pitali o tehničkom kvalitetu snimaka i da li primećuju nešto neobično. Svega 41% njih je izrazilo sumnju da bi snimci mogli biti generisani od strane AI. Tek u drugoj fazi, kada je eksplicitno rečeno da dataset sadrži određeni broj veštački generisanih radiograma, prosečna tačnost razlikovanja realnih i lažnih snimaka porasla je na 75%. Drugim rečima, ni uz upozorenje procena nije bila dovoljno pouzdana da bi se rizik smatrao zanemarljivim.

Posebno je indikativan jedan detalj koji ruši uobičajenu pretpostavku da iskustvo donosi bolju procenu. Nije zabeležena nikakva razlika u rezultatima u zavisnosti od iskustva radiologa, koji su imali između nula i 40 godina profesionalnog staža. Izuzetak su bili radiolozi subspecijalizovani za muskuloskeletnu radiologiju, i oni su postigli bolju tačnost od ostalih subspecijalnosti. Istovremeno, ni multimodalni veliki jezički modeli nisu pokazali pouzdanu sposobnost razlikovanja autentičnih od generisanih radiograma.

U zvaničnoj RSNA objavi navodi se da je tačnost četiri testirana modela, GPT-4o, GPT-5, Gemini 2.5 Pro i Llama 4 Maverick, bila u rasponu od 57% do 85% za jedan deo eksperimenta.

“Uznemirujuće i ne preterano iznenađujuće”

Autori upozoravaju da implikacije prevazilaze akademski okvir. Generisani rendgenski snimci mogu kompromitovati skupove podataka na kojima se treniraju budući AI sistemi, ali i otvoriti prostor za zloupotrebe u pravnim sporovima, osiguravajućim procedurama i kliničkoj dokumentaciji. Kako navodi vodeći autor studije Mickael Tordjman, realistični “deepfake” rendgeni predstavljaju visokorizičnu ranjivost, jer bi se fabrikovane promene, poput preloma, mogle prikazati kao verodostojni nalazi, dok bi eventualno ubacivanje takvih slika u bolničke mreže moglo direktno ugroziti dijagnostiku i poverenje u elektronski medicinski zapis.

Tri konkretna rizika

Zašto je ovo važno dalje od akademskog zanimanja? Postoje najmanje tri konkretna rizika.

Kontaminacija AI sistema. AI-generisani rendgeni, ako se nađu u skupovima podataka za treniranje, mogu da iskrive AI alate koji se koriste za analizu medicinskih podataka — što je svojevrsni začarani krug: loš AI trenira budući AI.

Pravni i osiguravaoci kontekst. U medicinskim sporovima i procedurama nadoknade troškova sve se češće koriste snimci kao dokaz. Ako se ne može pouzdano utvrditi autentičnost snimka, ceo sistem proveravanja može biti kompromitovan.

Integritet naučnih istraživanja. Ako sintetički snimci uđu u objavljene studije, namerno ili ne, zaključci tih studija postaju upitni, a procesi recenzije nisu opremljeni za ovakav tip prevare.

Kako prepoznati lažni snimak?

Studija nudi i obuku koja treba da pomogne radiolozima da unaprede svoje veštine otkrivanja AI-generisanih snimaka. Istraživači su opisali i vizuelne obrasce koji mogu pobuditi sumnju na sintetičko poreklo slike: kosti koje deluju previše glatko, neprirodno pravolinijske kičmene strukture, preterano simetrična pluća, uniformne vaskularne šare i frakturne linije koje izgledaju suviše čisto i konzistentno. Kao mere zaštite predlažu se napredne digitalne safeguard tehnike, uključujući nevidljive vodene žigove i kriptografske potpise povezane sa akvizicijom snimka, kako bi se jasnije razlikovali autentični od generisanih medicinskih prikaza.

Debata o zameni radiologa AI-jem

Celokupan kontekst ove studije dolazi u vreme kada se istovremeno vodi žestoka rasprava o tome koliko AI može da zameni radiologe u svakodnevnoj kliničkoj praksi. Direktor njujorškog javnog bolničkog sistema NYC Health+Hospitals, Mitchell Katz, izjavio je početkom aprila da bi AI u ovom trenutku već mogao da zameni znatan broj radiologa, ako se prevaziđe regulatorni izazov. Ova izjava je odmah naišla na oštre kritike stručne javnosti. Ovakvi nalazi direktno govore koliko je ta teza preuranjena.

Ključne činjenice

- Studija je objavljena 2026-03-24 u časopisu Radiology (izdanje RSNA).

- Učesnici: 17 radiologa iz 12 istraživačkih centara širom sveta

- Dizajn: 50% realnih, 50% AI-generisanih rendgena (ChatGPT/GPT-4o)

- Bez upozorenja: samo 41% radiologa posumnjalo da postoje AI snimci

- Sa upozorenjem: 75% prosečna tačnost identifikacije — bez razlike po godinama iskustva

- I veliki jezički modeli (LLM) pokazali su lošu tačnost pri razlikovanju

- Rizici: kontaminacija AI training skupova, pravni kontekst, integritet istraživanja

- Studija uključuje i smernice za trening radiologa u prepoznavanju sintetičkih snimaka

Izvori:

- Tordjman, M. et al. Radiology 318, e252094 (2026). Objavljeno: 2026-03-24. https://pubs.rsna.org

- Ahart, J. Nature News. „These medical X-rays are all deepfakes — and they fool even radiologists.“ Objavljeno: 2026-03-24. https://www.nature.com/articles/d41586-026-00892-3

- Wilkins, J. Futurism. „America’s Largest Hospital System Ready to Start Replacing Radiologists With AI.“ Objavljeno: 2026-04-04. https://futurism.com/artificial-intelligence/hospital-ceo-ai-radiology